AiLearning: 机器学习 - MachineLearning - ML、深度学习 - DeepLearning - DL、自然语言处理 NL

- 机器学习算法地图

- 机器学习 吴恩达 Coursera个人笔记 && 视频(含官方笔记)

- CS229 课程讲义中文翻译 && 机器学习 吴恩达 cs229个人笔记 && 官网(笔记) && 视频(中文字幕)

- 百页机器学习

- 《统计学习方法》李航 && 《统计学习方法》各章节笔记 && 《统计学习方法》各章节笔记 && 推荐答案:statistical-learning-method-solutions-manual 《统计学习方法》各章节笔记 && 《统计学习方法》各章节代码实现与课后习题参考解答

- 《模式识别与机器学习》 Christopher Bishop

- 《机器学习》 周志华 && 南瓜书:pumpkin-book

- 《机器学习实战》 PelerHarrington

- 机器学习与深度学习书单

- 深度学习思维导图 && 深度学习算法地图

- 《斯坦福大学深度学习基础教程》 Andrew Ng(吴恩达)

- 深度学习 吴恩达 个人笔记 && 视频

- MIT深度学习基础-2019视频课程

- 台湾大学(NTU)李宏毅教授课程 && [leeml-notes

- 图解深度学习_Grokking-Deep-Learning

- 《神经网络与深度学习》 Michael Nielsen

- CS321-Hinton

- CS230: Deep Learning

- CS294-112

- 《深度学习》 Yoshua Bengio.Ian GoodFellow⭐

- 《自然语言处理》Jacob Eisenstein

- 《强化学习》 && 第二版

- hangdong的深度学习博客,论文推荐

- Practical Deep Learning for Coders, v3

- 《Tensorflow实战Google深度学习框架》 郑泽宇 顾思宇

- 如何系统地学习算法? && LeetCode && leetcode题解 && 《算法导论》中算法的C++实现

- 机器学习算法实战

- 深度学习框架

- 如何成为一名算法工程师 && 从小白到入门算法,我的经验分享给你~ && 我的研究生这三年 ⭐

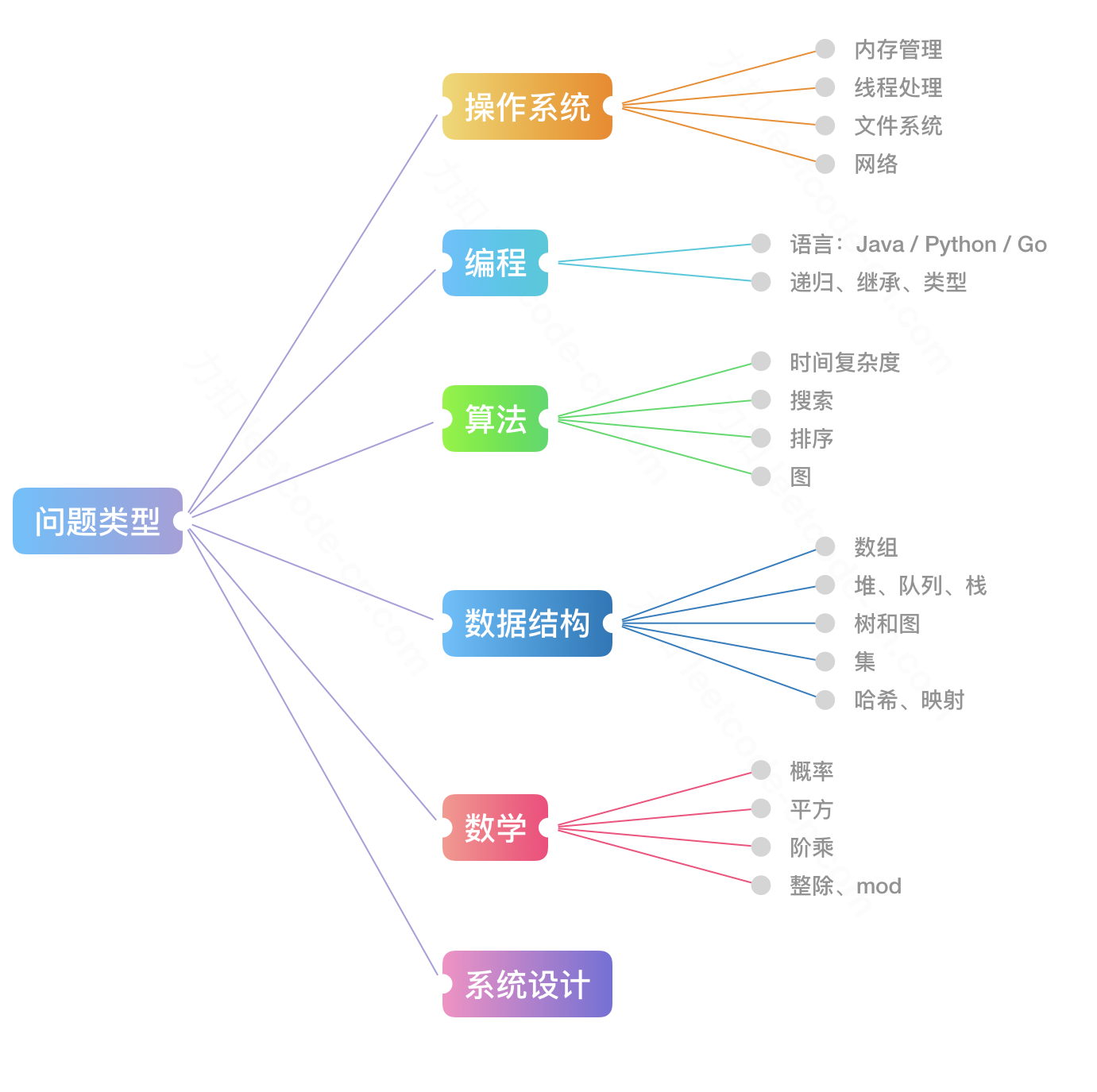

- 编程面试的题目分类

- 《AI算法工程师手册》

- 如何准备算法工程师面试,斩获一线互联网公司机器学习岗offer?

- 【完结】深度学习CV算法工程师从入门到初级面试有多远,大概是25篇文章的距离

- 计算机相关技术面试必备 && CS-WiKi && 计算机基础面试问题全面总结 && TeachYourselfCS-CN && 面试算法笔记-中文

- 算法工程师面试

- 深度学习面试题目

- 深度学习500问

- AI算法岗求职攻略

- Kaggle实战

- 常用算法:

- Feature Engineering:continue variable && categorical variable

- Classic machine learning algorithm:LR, KNN, SVM, Random Forest, GBDT(XGBoost&&LightGBM), Factorization Machine, Field-aware Factorization Machine, Neural Network

- Cross validation, model selection:grid search, random search, hyper-opt

- Ensemble learning

- kaggle竞赛宝典第一章-竞赛框架篇!:star:

- Kaggle 项目实战(教程) = 文档 + 代码 + 视频

- Kaggle入门系列:(一)机器学习环境搭建 && Kaggle入门系列:(二)Kaggle简介 && Kaggle入门系列(三)Titanic初试身手

- 从 0 到 1 走进 Kaggle

- Kaggle 入门指南

- 一个框架解决几乎所有机器学习问题 && Approaching (Almost) Any Machine Learning Problem | Abhishek Thakur

- 分分钟带你杀入Kaggle Top 1%

- 如何达到Kaggle竞赛top 2%?这里有一篇特征探索经验帖

- 如何在 Kaggle 首战中进入前 10%?

- Kaggle 首战 Top 2%, APTOS 2019 复盘总结 + 机器学习竞赛通用流程归纳

- kaggle的riiid比赛里关于数据处理时间空间优化的笔记

- 常用算法:

- 大数据&机器学习相关竞赛推荐

- 1. 一文看懂25个神经网络模型

- 2. DNN概述论文:详解前馈、卷积和循环神经网络技术

- 3. colah's blog

- 4. Model Zoom

- 5. DNN概述

- GitHub上的机器学习/深度学习综述项目合集

- AlphaTree-graphic-deep-neural-network

- 从LeNet-5到DenseNet

- 深度学习笔记(十一)网络 Inception, Xception, MobileNet, ShuffeNet, ResNeXt, SqueezeNet, EfficientNet, MixConv

- CNN网络结构的发展

- Awesome - Image Classification:论文&&代码大全

- pytorch-image-models

- 深度学习之目标检测的前世今生(Mask R-CNN)

- 深度学习目标检测模型全面综述:Faster R-CNN、R-FCN和SSD

- 从RCNN到SSD,这应该是最全的一份目标检测算法盘点

- 目标检测算法综述三部曲

- From RCNN to YOLOv3:上,下

- 后 R-CNN时代, Faster R-CNN、SSD、YOLO 各类变体统治下的目标检测综述:Faster R-CNN系列胜了吗?

- 目标检测进化史

- CVPR2019目标检测方法进展综述

- 一文看尽21篇目标检测最新论文(腾讯/Google/商汤/旷视/清华/浙大/CMU/华科/中科院等

- 我这两年的目标检测

- Anchor-Free目标检测算法: 第一篇:arxiv2015_baidu_DenseBox, 如何评价最新的anchor-free目标检测模型FoveaBox?, FCOS: 最新的one-stage逐像素目标检测算法 && 最新的Anchor-Free目标检测模型FCOS,现已开源! && 中科院牛津华为诺亚提出CenterNet,one-stage detector可达47AP,已开源! && AnchorFreeDetection

- Anchor free深度学习的目标检测方法

- 聊聊Anchor的"前世今生"(上)&&聊聊Anchor的"前世今生"(下)

- 目标检测算法综述之FPN优化篇 && 一文看尽物体检测中的各种FPN

- awesome-object-detection:论文&&代码

- deep_learning_object_detection

- ObjectDetectionImbalance

- 图像语义分割(Semantic segmentation) Survey

- 干货 | 一文概览主要语义分割网络

- 语义分割 发展综述

- 9102年了,语义分割的入坑指南和最新进展都是什么样的

- 实例分割最新最全面综述:从Mask R-CNN到BlendMask

- 语义分割综述:深度学习背景下的语义分割的发展状况【推荐】

- Awesome Semantic Segmentation:论文&&代码

- 一篇看完就懂的最新语义分割综述

- 基于深度学习的语义分割综述

- 如何走近深度学习人脸识别?你需要这篇超长综述 | 附开源代码

- 人脸检测和识别算法综述

- 人脸检测算法综述

- 人脸检测背景介绍和发展现状

- 人脸识别算法演化史

- CascadeCNN

- MTCNN

- awesome-Face_Recognition

- 异质人脸识别研究综述

- 老板来了:人脸识别+手机推送,老板来了你立刻知道。&& 手把手教你用Python实现人脸识别 && 人脸识别项目,网络模型,损失函数,数据集相关总结

- 基于深度学习的人脸识别技术综述 && 如何走近深度学习人脸识别?你需要这篇超长综述 && 人脸识别损失函数综述(附开源实现) && Face Recognition Loss on Mnist with Pytorch && 人脸识别的LOSS(上) && 人脸识别的LOSS(下)

- 人脸关键点检测

- A Comprehensive Introduction to Different Types of Convolutions in Deep Learning && 翻译:上、下

- 卷积有多少种?一文读懂深度学习中的各种卷积

- 各种卷积

- Convolution Network及其变种(反卷积、扩展卷积、因果卷积、图卷积)

- 深度学习基础--卷积类型

- 变形卷积核、可分离卷积

- 对深度可分离卷积、分组卷积、扩张卷积、转置卷积(反卷积)的理解

- 反卷积

- Dilated/Atrous conv 空洞卷积/多孔卷积

- 卷积层输出大小尺寸计算及 “SAME” 和 “VALID” && 卷积的三种模式full, same, valid以及padding的same, valid

- 正常卷积与空洞卷积输出特征图与感受野大小的计算

- 【Tensorflow】tf.nn.depthwise_conv2d如何实现深度卷积?

- 【Tensorflow】tf.nn.atrous_conv2d如何实现空洞卷积?

- 【Tensorflow】tf.nn.separable_conv2d如何实现深度可分卷积?

- 【TensorFlow】tf.nn.conv2d_transpose是怎样实现反卷积的?

- 卷积神经网络工作原理

- 「七夕的礼物」: 一日搞懂卷积神经网络

- 一文读懂卷积神经网络中的1x1卷积核

- 如何理解神经网络中通过add和concate的方式融合特征? && 神经网络中对需要concat的特征进行线性变换然后相加是否好于直接concat?

- CNN 模型所需的计算力(flops)和参数(parameters)数量是怎么计算的? && 深度学习中卷积的参数量和计算量

- 经典CNN模型LeNet解读

- 机器学习进阶笔记之三 | 深入理解Alexnet

- 一文读懂VGG网络

- Inception V1,V2,V3,V4 模型总结

- ResNet解析

- 一文简述ResNet及其多种变体

- CapsNet入门系列

- 深入剖析MobileNet和它的变种(例如:ShuffleNet)为什么会变快?

- CNN模型之ShuffleNet

- ShuffleNet V2和四个网络架构设计准则

- ResNeXt 深入解读与模型实现

- 如何评价Momenta ImageNet 2017夺冠架构SENet?

- CBAM:卷积块注意力模块 && CBAM: Convolutional Block Attention Module

- SKNet——SENet孪生兄弟篇

- GCNet:当Non-local遇见SENet

- 深度学习笔记(十一)网络 Inception, Xception, MobileNet, ShuffeNet, ResNeXt, SqueezeNet, EfficientNet, MixConv

- 如何评价最新的Octave Convolution?

- ResNeSt 之语义分割 && 关于ResNeSt的点滴疑惑 && ResNeSt在刷榜之后被ECCV2020 strong reject

- 目标检测的性能评价指标 && NMS和计算mAP时的置信度阈值和IoU阈值 && 白话mAP && 目标检测模型的评估指标mAP详解(附代码)

- 深度学习中IU、IoU(Intersection over Union)

- Selective Search for Object Detection (译文)

- Region Proposal Network(RPN)

- 边框回归(Bounding Box Regression)详解

- NMS——非极大值抑制 && 非极大值抑制NMS的python实现

- 一文打尽目标检测NMS——精度提升篇 && 一文打尽目标检测NMS——效率提升篇

- 目标检测回归损失函数简介:SmoothL1/IoU/GIoU/DIoU/CIoU Loss

- 将CNN引入目标检测的开山之作:R-CNN

- R-CNN论文详解

- 深度学习(十八)基于R-CNN的物体检测

- Fast R-CNN

- 深度学习(六十四)Faster R-CNN物体检测 && 你真的学会RoI Pooling了吗?

- 目标检测论文阅读:Feature Pyramid Networks for Object Detection

- SSD

- 实例分割--Mask RCNN详解(ROI Align / Loss Function) && 令人拍案称奇的Mask RCNN

- 何恺明大神的「Focal Loss」,如何更好地理解? && FocalLoss 对样本不平衡的权重调节和减低损失值 && focal_loss 多类别和二分类 Pytorch代码实现 && 多分类focal loss及其tensorflow实现

- 堪比Focal Loss!解决目标检测中样本不平衡的无采样方法

- 目标检测正负样本区分策略和平衡策略总结(一) && 目标检测正负样本区分策略和平衡策略总结(二) && 目标检测正负样本区分策略和平衡策略总结(三)

- YOLO && 目标检测|YOLO原理与实现 && 图解YOLO && 【论文解读】Yolo三部曲解读——Yolov1

- 目标检测|YOLOv2原理与实现(附YOLOv3) && YOLO2 && 【论文解读】Yolo三部曲解读——Yolov2

- <机器爱学习>YOLO v3深入理解 && 【论文解读】Yolo三部曲解读——Yolov3

- YOLOv4

- 目标检测之CornerNet, 1, 2, 3

- 目标检测小tricks--样本不均衡处理

- 超像素、语义分割、实例分割、全景分割 傻傻分不清 && 语义分割、实例分割和全景分割的区别

- 语义分割卷积神经网络快速入门

- 图像语义分割入门+FCN/U-Net网络解析 && 深入理解深度学习分割网络Unet

- Unet神经网络为什么会在医学图像分割表现好?

- 图像语义分割的工作原理和CNN架构变迁

- 语义分割中的Attention和低秩重建

- 打通多个视觉任务的全能Backbone:HRNet

- 深度学习中的注意力模型(2017版)

- Attention Model(mechanism) 的 套路

- 计算机视觉中的注意力机制(推荐)

- More About Attention(推荐)

- 计算机视觉中的注意力机制

- NLP中的Attention Mechanism

- Transformer中的Attention

- 综述:图像处理中的注意力机制

- PyTorch官方实现ResNet && pytorch_resnet_cifar10

- PyTorch 63.Coding for FLOPs, Params and Latency

- 先读懂CapsNet架构然后用TensorFlow实现

- 目标检测-20种模型的原味代码汇总

- TensorFlow Object Detection API 教程

- 在TensorFlow+Keras环境下使用RoI池化一步步实现注意力机制

- mxnet如何查看参数数量 && mxnet查看FLOPS

- Pytorch-UNet

- segmentation_models.pytorch

- 千奇百怪的GAN变体

- 苏剑林博客,讲解得淋漓尽致

- The GAN Landscape:Losses, Architectures, Regularization, and Normalization

- 深度学习新星:GAN的基本原理、应用和走向

- GAN生成图像综述

- 2017年GAN 计算机视觉相关paper汇总

- 必读的10篇关于GAN的论文

- GAN原理学习笔记

- GAN万字长文综述

- 极端图像压缩的对抗生成网络

- 台湾大学李宏毅GAN教程

- CycleGAN:图片风格,想换就换 | ICCV 2017论文解读

- Wasserstein GAN && GAN:两者分布不重合JS散度为log2的数学证明

- 用变分推断统一理解生成模型(VAE、GAN、AAE、ALI)

-

word2vec

- 推荐:nlp-tutorial

- nlp-tutorial

- tensorflow中RNNcell源码分析以及自定义RNNCell的方法

- TensorFlow中RNN实现的正确打开方式

- TensorFlow RNN 代码

- Tensorflow实现的深度NLP模型集锦

- 用tensorflow LSTM如何预测股票价格

- TensorFlow的多层LSTM实践

- 《安娜卡列尼娜》文本生成——利用TensorFlow构建LSTM模型

- Graph Neural Network(GNN)综述

- 深度学习时代的图模型,清华发文综述图网络

- 清华大学图神经网络综述:模型与应用

- 图神经网络概述第三弹:来自IEEE Fellow的GNN综述

- GNN最全文献资料整理 && Awesome-Graph-Neural-Networks

- 如何理解 Graph Convolutional Network(GCN)

- 图卷积网络(GCN)新手村完全指南

- 何时能懂你的心——图卷积神经网络(GCN)

- 图卷积网络GCN的理解与介绍

- 一文读懂图卷积GCN

- 2020 年 GNN 开卷有益与再谈图卷积

- 【GCN】万字长文带你入门 GCN

- 如何解决图神经网络(GNN)训练中过度平滑的问题?

- 全连接的图卷积网络(GCN)和self-attention这些机制有什么区别联系 && CNN与GCN的区别、联系及融合

- 1. 优化算法纵览

- 2. 从梯度下降到Adam

- 3. 从梯度下降到拟牛顿法:盘点训练神经网络的五大学习算法

- 4. 正则化技术总结

- 权重衰减(weight decay)与学习率衰减(learning rate decay) && pytorch必须掌握的的4种学习率衰减策略

- 5. 最优化算法系列(math)

- 6. 神经网络训练中的梯度消失与梯度爆炸

- 7. 神经网络的优化及训练

- 8. 通俗讲解查全率和查准率 && 全面梳理:准确率,精确率,召回率,查准率,查全率,假阳性,真阳性,PRC,ROC,AUC,F1 && 机器学习之类别不平衡问题 (1) —— 各种评估指标 && 机器学习之类别不平衡问题 (2) —— ROC和PR曲线 && AUC详解与python实现 && 微平均和宏平均 && 机器学习中的性能度量 && 精确率、召回率、F1 值、ROC、AUC 各自的优缺点是什么

- 激活函数一览 && 深度学习中几种常见的激活函数理解与总结

- 深度学习笔记(三):激活函数和损失函数

- 激活函数/损失函数汇总

- 机器学习中常见的损失函数及其应用场景 && PyTorch的十八个损失函数

- 深度度量学习中的损失函数

- 反向传播算法(过程及公式推导)

- 通俗理解神经网络BP传播算法

- 10. Coursera吴恩达《优化深度神经网络》课程笔记(3)-- 超参数调试、Batch正则化和编程框架

- 11. 机器学习各种熵

- 12. 距离和相似性度量

- 13. 机器学习里的黑色艺术:normalization, standardization, regularization && 数据标准化/归一化normalization && 特征工程中的「归一化」有什么作用?

- 14. LSTM系列的梯度问题

- 15. 损失函数整理

- 16. 详解残差块为何有助于解决梯度弥散问题

- 17. FAIR何恺明等人提出组归一化:替代批归一化,不受批量大小限制

- 18. Batch Normalization(BN):1 ,2 ,3 ,4 , 5, 6, 7

- 19. 详解深度学习中的Normalization,不只是BN && 如何区分并记住常见的几种 Normalization 算法

- 20. BFGS

- 21. 详解深度学习中的梯度消失、爆炸原因及其解决方法 && 神经网络梯度消失和梯度爆炸及解决办法

- 22. Dropout, 1, 2, 3,系列解读Dropout

- 23.谱归一化(Spectral Normalization)的理解,常见向量范数和矩阵范数,谱范数正则(Spectral Norm Regularization)的理解

- 24.L1正则化与L2正则化 && 深入理解L1、L2正则化 && L2正则=Weight Decay?并不是这样 && 都9102年了,别再用Adam + L2 regularization

- 25.为什么选用交叉熵而不是MSE &&为什么使用交叉熵作为损失函数 &&二元分类为什么不能用MSE做为损失函数?&& 为什么平方损失函数不适用分类问题?

- 浅谈神经网络中的梯度爆炸问题

- 为什么weight decay能够防止过拟合

- 交叉熵代价函数(作用及公式推导) && 交叉熵损失的来源、说明、求导与pytorch实现 && Softmax函数与交叉熵 && 极大似然估计与最小化交叉熵损失或者KL散度为什么等价

- 梯度下降优化算法纵览, 1, 2, 几种优化算法的比较(BGD、SGD、Adam、RMSPROP)

- Softmax:详解softmax函数以及相关求导过程 && softmax的log似然代价函数(公式求导) && 【技术综述】一文道尽softmax loss及其变种

- 从最优化的角度看待Softmax损失函数 && Softmax理解之二分类与多分类 && Softmax理解之Smooth程度控制 && Softmax理解之margin

- 权重初始化

- 为什么说bagging是减少variance,而boosting是减少bias?

- 训练的神经网络不工作?一文带你跨过这37个坑

- Deep Learning 之 训练过程中出现NaN问题

- 神经网络训练trick

- 你有哪些deep learning(rnn、cnn)调参的经验?

- GAN的一些小trick

- 深度学习与计算机视觉系列(8)_神经网络训练与注意点

- 神经网络训练loss不下降原因集合 && loss不下降的解决方法

- 深度学习:欠拟合问题的几种解决方案 &&过拟合和欠拟合问题

- 机器学习:如何找到最优学习率及实现

- 神经网络中 warmup 策略为什么有效

- 不平衡数据集处理方法: 其一, 其二, 其三 && Awesome Imbalanced Learning && Class-balanced-loss-pytorch

- 同一个神经网络使用不同激活函数的表达能力是否一致

- 论文笔记之数据增广:mixup

- 避坑指南:数据科学家新手常犯的13个错误

- 凭什么相信CNN的结果?--可视化

- 大卷积核还是小卷积核? 1, 2

- 模型可解释性差?你考虑了各种不确定性了吗?

- 炼丹笔记系列

- 炼丹笔记三:数据增强 && 数据增强(Data Augmentation)

- 【技术综述】 深度学习中的数据增强(上) && 【技术综述】深度学习中的数据增强(下)

- 深度学习数据增广技术一览

- 《Bag of Tricks for Image Classification with CNN》&& pdf

- 深度神经网络模型训练中的最新tricks总结【原理与代码汇总】 && 神经网络训练trick

- Kaggle解决方案分享

- ensemble

- deformable

- sync bn

- ms train/test

- 目标检测任务的优化策略tricks

- 目标检测小tricks--样本不均衡处理

- 汇总|目标检测中的数据增强、backbone、head、neck、损失函数

- 目标检测算法中的常见trick

- Bag of Freebies —— 提升目标检测模型性能的免费tricks

- 目标检测比赛中的tricks(已更新更多代码解析)

- Kaggle:肺癌自动诊断系统3D Deep Leaky Noisy-or Network 论文阅读

- 干货|大神教你如何参加kaggle比赛——根据CT扫描图预测肺癌

- The Python Tutorial

- 廖雪峰Python教程

- 菜鸟教程

- 给深度学习入门者的Python快速教程 - 基础篇

- Python - 100天从新手到大师

- Python中读取,显示,保存图片的方法 && Python的图像打开保存显示的几种方式

- OpenCV-Python Tutorials

- OpenCV官方教程中文版(For Python)

- 数字图像处理系列

- python+OpenCV图像处理

- 给深度学习入门者的Python快速教程 - 番外篇之Python-OpenCV

- 如何高效地学习 TensorFlow 代码

- 中文教程

- TensorFlow官方文档

- CS20:Tensorflow for DeepLearning Research

- 吴恩达TensorFlow专项课程

- 【干货】史上最全的Tensorflow学习资源汇总

- 《21个项目玩转深度学习———基于TensorFlow的实践详解》

- 最全Tensorflow2.0 入门教程持续更新

- Github优秀开源教程

- Pytorch版动手学深度学习

- PyTorch中文文档

- WELCOME TO PYTORCH TUTORIALS

- 史上最全的PyTorch学习资源汇总

- 【干货】史上最全的PyTorch学习资源汇总

- Hands-on tour to deep learning with PyTorch

- pytorch学习(五)—图像的加载/读取方式 && PyTorch—ImageFolder/自定义类 读取图片数据

- Top 50 matplotlib Visualizations – The Master Plots (with full python code)

- Python之MatPlotLib使用教程

- 十分钟上手matplotlib,开启你的python可视化

- 给深度学习入门者的Python快速教程 - numpy和Matplotlib篇

- 1. 25个深度学习相关公开数据集

- 2. 自然语言处理(NLP)数据集

- 3.全唐诗(43030首)

- 4. 伯克利大学公开数据集

- 5. ACL 2018资源:100+ 预训练的中文词向量

- 6. 预训练中文词向量

- 7. 公开数据集种子库

- 8. 计算机视觉,深度学习,数据挖掘数据集整理

- 9. 计算机视觉著名数据集CV Datasets

- 10. 计算机视觉相关数据集和比赛

- 11. 这是一份非常全面的开源数据集,你,真的不想要吗?

- 12. 人群密度估计现有主要数据集特点及其比较

- 13. DANBOORU2017: A LARGE-SCALE CROWDSOURCED AND TAGGED ANIME ILLUSTRATION DATASET

- 14. 行人重识别数据集

- 15. 自然语言处理常见数据集、论文最全整理分享

- 16. paper, code, sota

- 17. 旷视RPC大型商品数据集发布!

- 18. CVPR 2019「准满分」论文:英伟达推出首个跨摄像头汽车跟踪数据集(汽车Re-ID)

- 19.【OCR技术】大批量生成文字训练集

- 20. 语义分析数据集-MSRA

- IEEE DataPort

- 数据集市

- 医疗/医学图像数据集:Medical Data for Machine Learning && 医疗领域图像挑战赛数据集 && 【医学影像系列:一】数据集合集 最新最全 && medical-imaging-datasets && 【数据集】一文道尽医学图像数据集与竞赛 && 医学图像数据集汇总

- 刘知远_如何写一篇合格的NLP论文

- 刘洋_如何写论文_V7

- 如何端到端地写科研论文-邱锡鹏

- 论文Introduction写作其一, 论文Introduction写作其二, 论文Introduction写作其三

- 毕业论文怎么写

- 浅谈学术论文rebuttal && 学术论文投稿与返修(Rebuttal)分享

- 研之成理写作实验室

- 智源论坛·论文写作专题报告会:《论文写作小白的成长之路》 && 《谈如何写一篇合格的国际学术论文》 && 《计算机视觉会议论文从投稿到接收》

- ResearchGo:研究生活第一帖——文献检索与管理

- ResearchGo:研究生活第二贴——文献阅读

- ResearchGo:研究生活第三帖——阅读辅助

- ResearchGo:研究生活第四帖——文献调研

- ResearchGo:研究生活第五帖——文献综述

- ResearchGo:研究生活第六帖——如何讲论文

- ResearchGo:研究生活第七帖——专利检索与申请

- ResearchGo:研究生活第八帖——写论文、做PPT、写文档必备工具集锦

- 机器学习原理⭐

- ID3、C4.5、CART、随机森林、bagging、boosting、Adaboost、GBDT、xgboost算法总结

- 数据挖掘十大算法简要说明,机器学习十大经典算法入门 && 【算法模型】轻松看懂机器学习十大常用算法

- AdaBoost到GBDT系列

- 最常见核心的决策树算法详细介绍,含ID3、C4.5、CART:star: && 最常用的决策树算法!Random Forest、Adaboost、GBDT 算法:star: && 终于有人把XGBoost 和 LightGBM 讲明白了,项目中最主流的集成算法!:star:

- 为什么xgboost要用泰勒展开,优势在哪里

- Python3《机器学习实战》学习笔记(二):决策树基础篇之让我们从相亲说起

- Python3《机器学习实战》学习笔记(三):决策树实战篇之为自己配个隐形眼镜

- 机器学习实战教程(十三):树回归基础篇之CART算法与树剪枝

- 《机器学习实战》基于信息论的三种决策树算法(ID3,C4.5,CART)

- 说说决策树剪枝算法

- 机器学习实战 第九章 树回归

- 决策树值ID3、C4.5实现

- 决策树之CART实现

- 【机器学习面试总结】—— SVM

- SVM系列-从基础到掌握

- SVM通俗导论 July

- 核函数 : 机器学习有很多关于核函数的说法,核函数的定义和作用是什么? && SVM中,高斯核为什么会把原始维度映射到无穷多维? && svm核函数的理解和选择 && 核函数和径向基核函数 (Radial Basis Function)--RBF && SVM核函数

- LightGBM大战XGBoost

- 概述XGBoost、Light GBM和CatBoost的同与不同 && XGBoost、LightGBM、Catboost总结 && XGBoost、Light GBM和CatBoost的参数及性能比较

- 梯度提升决策树

- GBDT原理及应用

- XGBOOST原理篇

- xgboost入门与实战(原理篇) && xgboost入门与实战(实战调参篇)

- 【干货合集】通俗理解kaggle比赛大杀器xgboost

- GBDT分类的原理及Python实现

- GBDT原理及利用GBDT构造新的特征-Python实现

- Python+GBDT算法实战——预测实现100%准确率

- xgboost之近似分位数算法(直方图算法)详解

- 马尔科夫决策过程之Markov Processes(马尔科夫过程)

- 马尔科夫决策过程之Markov Reward Process(马尔科夫奖励过程)

- 马尔科夫决策过程之Bellman Equation(贝尔曼方程)

- 马尔科夫决策过程之Markov Decision Process(马尔科夫决策过程)

- 马尔科夫决策过程之最优价值函数与最优策略

- 机器学习中,有哪些特征选择的工程方法? && 机器学习(四):数据预处理--特征工程概述 && 特征工程完全手册 - 从预处理、构造、选择、降维、不平衡处理,到放弃 && 特征工程中的「归一化」有什么作用

- 15分钟带你入门sklearn与机器学习——分类算法篇 && 如何为你的回归问题选择最合适的机器学习方法?

- 十分钟上手sklearn:安装,获取数据,数据预处理 && 十分钟上手sklearn:特征提取,常用模型,交叉验证

- MachineLearning_Python

- Machine Learning Course with Python

- Statistical-Learning-Method_Code

- Python3机器学习

- 含大牛总结的分类模型一般需要调节的参数

- 模型汇总-14 多任务学习-Multitask Learning概述

- (译)深度神经网络的多任务学习概览(An Overview of Multi-task Learning in Deep Neural Networks)

- Multi-task Learning and Beyond: 过去,现在与未来;

- few-shot learning是什么

- 零次学习(Zero-Shot Learning)入门

- 小样本学习(Few-shot Learning)综述

- Few-Shot Learning in CVPR 2019

- 当小样本遇上机器学习 fewshot learning

- 1. 迁移学习:经典算法解析

- 2. 什么是迁移学习 (Transfer Learning)?这个领域历史发展前景如何?

- 3. 迁移学习个人笔记

- 迁移学习总结(One Shot Learning, Zero Shot Learning)

- Domain Adaptation视频教程(附PPT)及经典论文分享

- 模型汇总15 领域适应性Domain Adaptation、One-shot/zero-shot Learning概述

- 【深度学习】论文导读:无监督域适应(Deep Transfer Network: Unsupervised Domain Adaptation)

- 【论文阅读笔记】基于反向传播的无监督域自适应研究

- 【Valse大会首发】领域自适应及其在人脸识别中的应用

- CVPR 2018:基于域适应弱监督学习的目标检测

- 强化学习(Reinforcement Learning)知识整理

- 强化学习从入门到放弃的资料

- 强化学习入门

- 强化学习——从Q-Learning到DQN到底发生了什么?

- 从强化学习到深度强化学习(上)

- 从强化学习到深度强化学习(下)

- 一文带你理解Q-Learning的搜索策略